Así puede defenderse en caso de ser víctima de delitos informáticos cometidos con IA

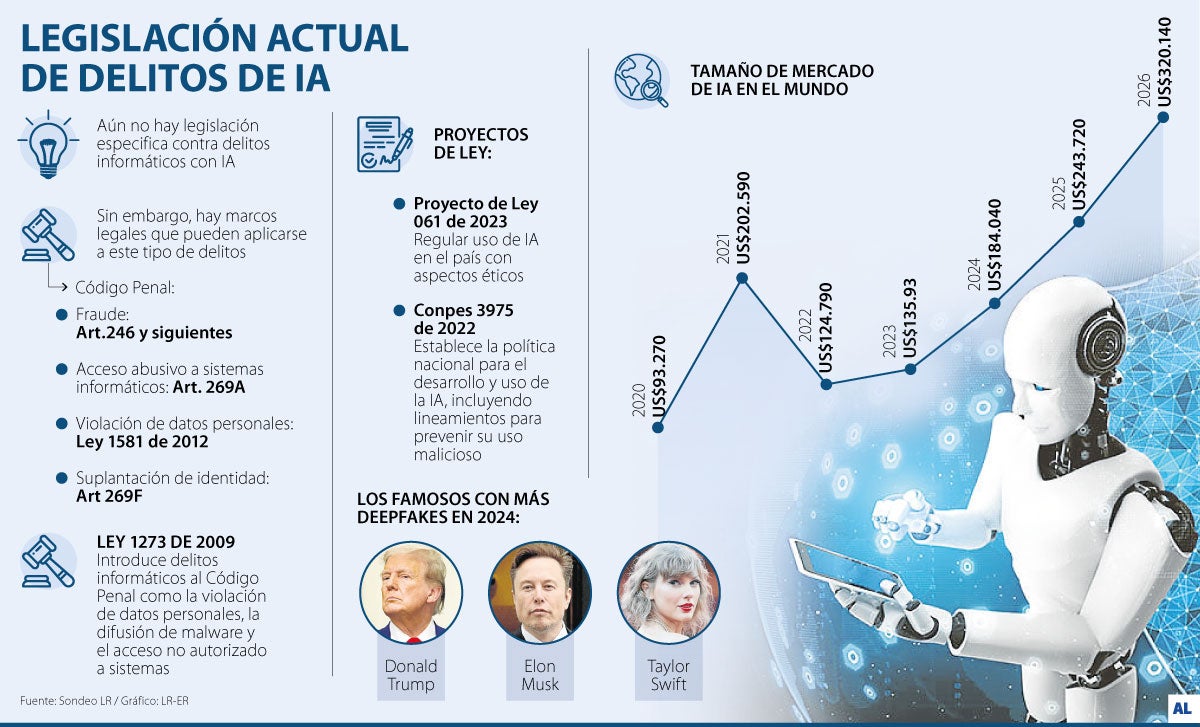

El proyecto de Ley 061 de 2023 busca regular el uso de IA en el país con aspectos éticos, mientras que el Conpes 3975 de 2022, establece la política nacional para el desarrollo y uso de la IA

17 de febrero de 2025“Podemos perder el control de la realidad”, fue la advertencia que hizo la actriz Scarlett Johansson luego de que se compartió un vídeo con su imagen realizado a partir de inteligencia artificial. Sin embargo,esta problemática no es exclusiva de EE.UU., sino que en nuestro país también es víctima de una tecnología que aún no sabemos cómo regular.

La IA es un mercado de US$184.040 millones en el mundo, y aunque esta tecnología ha permitido ahorrar tiempos en varios procesos, hay quienes las utilizan para realizar delitos y suplantaciones de imagen, entre otros.

“Nuestro Código Penal colombiano ya tiene estipulado el delito de la estafa, el cual implica entre 32 y 144 meses de pena privativa de la libertad. También, adicional a esto, recordar que hay unos avances en la tipificación de algunos delitos informáticos, de tecnología y de telecomunicaciones”, dijo Jenny Lindo, contralora delegada para la justicia y profesora de UniAndes.

Desde el Gobierno se viene trabajando un proyecto de ley y el Conpes, que buscan poner marcos a estas tecnologías. El proyecto de Ley 061 de 2023 busca regular el uso de IA en el país con aspectos éticos, mientras que el Conpes 3975 de 2022, establece la política nacional para el desarrollo y uso de la IA, incluyendo lineamientos para prevenir su uso malicioso.

“Uno de los principales retos para regular las estafas con deepfakes y voces generadas con IA, es que la tecnología avanza más rápido que la legislación”, dijo Fernán Ocampo, presidente de LinkTIC, empresa de IT y desarrollo de software.

Sin embargo, hay marcos legales que pueden aplicarse a este tipo de delitos. Como explicó Andrés Felipe Caballero, fundador de Caballero Sierra Abogados Litigantes,existe el artículo 87 de la Ley 23 de 1982, el cual establece que los derechos sobre la imagen de una persona son intransferibles e irrenunciables, salvo consentimiento expreso.

“Este artículo protege a las personas contra la explotación comercial no autorizada de su imagen, lo que es clave en el caso de los deepfakes usados con fines comerciales o engañosos”, manifestó el abogado litigante.

Deepfakes VS Audios con IA

En redes sociales ya circulan nuevas modalidades de extorsión y estafas en donde los criminales suplantan la voz de seres queridos mediante la IA y llaman a las personas para pedir dinero alegando que “están en problemas”.

Si bien esta no es una práctica nueva, el uso de IA hace más difícil la detección de este tipo de delitos.

Aunque tanto los deepfakes como la suplantación con audios utilizan tecnologías avanzadas de inteligencia artificial, la diferencia radica en el tipo de contenido que está siendo manipulado.

“Los deepfakes generalmente implican la creación de un video o de imágenes falsas, mientras que los audios de IA se enfocan en la clonación de la voz. Legalmente, ambos podrían ser perseguidos bajo delitos de fraude, estafa o falsedad personal, pero los deepfakes pueden también involucrar violaciones adicionales de derechos de imagen, extorsiones, y demás”, dijo Juana Cajiao Reina, asociada en la firma Holland & Knight.

Agregó: “El derecho a la imagen está protegido por la Constitución y el Código Civil, que establecen que el uso no autorizado de la imagen de una persona puede dar lugar a acciones legales por daños y perjuicios. Además, es importante considerar el propósito de los deepfakes, ya que si se utilizan para extorsión o estafa, se trataría de delitos tipificados”.

¿Qué soluciones puede haber?

Mientras que la legislación colombiana camina, la inteligencia artificial va en un Ferrari. Regular los usos de esta tecnología es difícil, más no imposible y se pueden hacer varios avances para prevenir estos delitos informáticos.

“Se podría proponer una ley específica que regule la creación y distribución de deepfakes, incluir en el Código Penal artículos que sancionen su creación y difusión sin consentimiento, especialmente cuando se utilicen para cometer fraudes, suplantación de identidad o difundir contenido sexual no autorizado”, dijo Cajiao Reina.

De igual manera, el presidente de LinkTic también propuso que “las leyes deben enfocarse en castigar el uso malintencionado sin frenar la innovación ni la libertad de expresión. Sin embargo, la regulación por sí sola no es suficiente: la educación juega un papel clave”.

Legislación de IA en el mundo

Recién Ase están tomando los primeros pasos para regular esta nueva tecnología en Colombia y el mundo. Un ejemplo de ello es el caso de California en Estados Unidos,que avanza con propuestas de ley para regular los usos de la inteligencia artificial.

“California ahora es de los más sonados, puesto que el 1° de marzo de 2025 inicia su ley de prevención antifraude por voces generadas por inteligencia artificial. Y lo que hace el gobierno de California es imponerle a estas empresas, a estas plataformas multiplicadoras y amplificadoras de inteligencia artificial, la obligación de poner viñetas o marcas de agua, marcar todos los audios y voces y vídeos generados por productos de inteligencia artificial” manifestó, Jenny Lindo.

¿Usted sería capaz de identificar una llamada de una IA que suena igual a un ser querido y le pide ayuda?

Antecedentes

El Proyecto de Ley 091-2023 define la obligación de informar sobre el uso responsable de la IA en el país. Esta iniciativa tiene como objetivo asegurar que la implementación de la IA se lleve a cabo bajo principios éticos y legales, garantizando la seguridad, transparencia, igualdad y equidad para los usuarios. Asimismo, fomenta la creación de programas educativos y de investigación dirigidos al desarrollo responsable de la IA, destacando la importancia de la formación.

¿Quiere publicar su edicto en línea?

Contáctenos vía WhatsApp